Avansert AI: ComfyUI

OpenShot kan koble til en lokal ComfyUI-server og kjøre AI-arbeidsflyter fra kontekstmenyene Project Files og Timeline. Denne siden forklarer hva disse verktøyene er, hvilken maskinvare de krever, og hvor de innebygde arbeidsflytmalene bor.

Advarsel

AI-funksjoner i OpenShot er eksperimentelle og krever en avansert arbeidsstasjon.

Disse verktøyene er ikke anbefalt for bærbare datamaskiner, mellomklasse stasjonære eller budsjettsystemer.

Du må kjøre en lokal ComfyUI server.

Du bør forvente nedlastinger av modeller, oppsett og feilsøking av arbeidsflyter.

Minimum anbefalt maskinvare

Komponent |

Anbefaling |

|---|---|

GPU |

NVIDIA 5070 12 GB eller bedre (16-24 GB VRAM sterkt foretrukket) |

CPU |

Ryzen 9 5900-klasse CPU (eller tilsvarende høyklokket flerkjerne) |

Systemminne |

64GB RAM eller mer |

Lagring |

200GB ledig plass for modeller, cache og genererte utdata |

Erfaring |

Komfortabel med ComfyUI-grafer, modeller og nodeavhengigheter |

Hvis systemet ditt er under disse nivåene, vil jobber stoppe opp, feile og gi ustabile resultater. Hvis GPU-en din har 8GB eller mindre VRAM, vil du gå tom for minne når du kjører disse modellene.

Installasjon og oppsett

Bruk denne raske oppsettsveien før du prøver noen AI-arbeidsflyt i OpenShot:

Installer ComfyUI og bekreft at det starter riktig.

Installer nødvendige egendefinerte noder (listet nedenfor).

Last ned nødvendige modellfiler (listet nedenfor) til tilsvarende modellmapper.

Start ComfyUI, åpne deretter Rediger->Innstillinger->Avansert og angi ComfyUI URL.

Klikk Check for å bekrefte at OpenShot kan nå serveren.

For en fullstendig trinnvis veiledning for serveroppsett, se OpenShot-wikien: ComfyUI: Advanced AI Setup Guide.

For fullstendige detaljer om ComfyUI-installasjon, se det offisielle depotet: ComfyUI på GitHub.

Nødvendige egendefinerte noder

Nødvendige modeller / filer

ComfyUI/models/diffusion_models/wan2.1_vace_1.3B_fp16.safetensorsComfyUI/custom_nodes/ComfyUI-Frame-Interpolation/ckpts/rife/rife47.pthComfyUI/models/checkpoints/sd_xl_base_1.0.safetensorsComfyUI/models/checkpoints/sd_xl_refiner_1.0.safetensorsComfyUI/models/checkpoints/stable-audio-open-1.0.safetensorsComfyUI/models/clip_vision/clip_vision_g.safetensorsComfyUI/models/diffusion_models/wan2.2_ti2v_5B_fp16.safetensorsComfyUI/models/grounding-dino/groundingdino_swint_ogc.pthComfyUI/models/sam2/sam2.1_hiera_base_plus.ptComfyUI/models/sam2/sam2.1_hiera_small-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_small.ptComfyUI/models/sam2/sam2.1_hiera_tiny-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_tiny.ptComfyUI/models/sam2/sam2_hiera_small.ptComfyUI/models/stt/whisper/large-v3.ptComfyUI/models/stt/whisper/medium.ptComfyUI/models/text_encoders/t5-base.safetensorsComfyUI/models/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensorsComfyUI/models/TTS/Ace-Step1.5/acestep-v15-turbo/silence_latent.ptComfyUI/models/upscale_models/RealESRGAN_x4plus.safetensorsComfyUI/models/vae/wan_2.1_vae.safetensorsComfyUI/models/vae/wan2.2_vae.safetensorsComfyUI/models/VLM/transnetv2-pytorch-weights/transnetv2-pytorch-weights.pth

Hva brukere ser i OpenShot

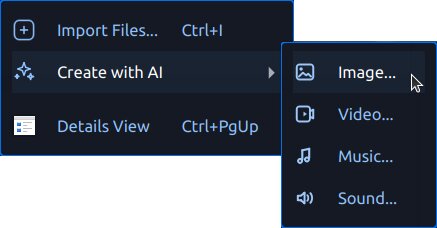

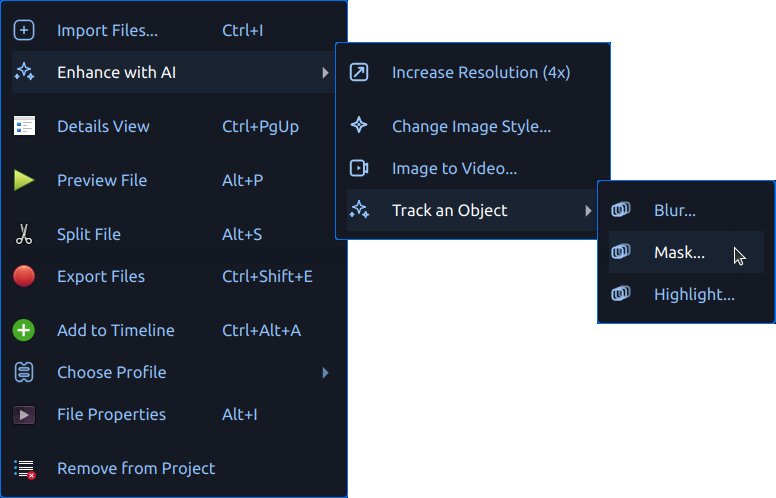

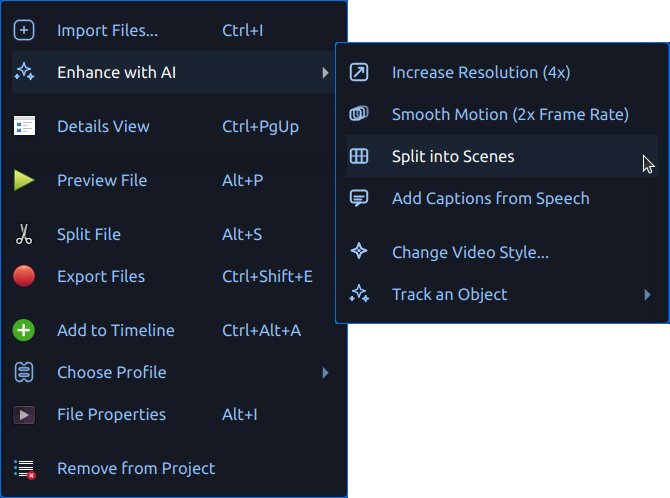

Når ComfyUI er tilgjengelig, viser OpenShot AI-verktøy i kontekstmenyer:

Opprett med AI for å lage nye ressurser

Forbedre med AI (bilder) for å behandle bildeelementer

Forbedre med AI (videoer) for å behandle videoelementer

Genererte filer legges til i Prosjektfiler med fremdriftstekst og kømerker. Utdata lagres under .openshot_qt/comfyui-output/.

Å starte et nytt prosjekt eller åpne et eksisterende prosjekt tømmer de midlertidige .openshot_qt AI-arbeidsmappene slik at du begynner med et rent utgangspunkt. Dine lagrede prosjekter påvirkes ikke, og eventuelle ressurser som tidligere er kopiert til en PROJECTNAME_Assets-mappe forblir i den prosjektmappen.

Hvis ComfyUI ikke er tilgjengelig, deaktiverer OpenShot AI-menyene. Konfigurer serverens URL i Rediger->Innstillinger->Avansert, bruk deretter Check-knappen for å teste tilkoblingen.

Arbeidsflytsmaler

OpenShot leser innebygde maler fra comfyui/. Den laster også inn egendefinerte brukermaler fra ~/.openshot_qt/comfyui/.

For å legge til din egen arbeidsflyt:

I ComfyUI, åpne arbeidsflytfanen du vil bruke.

Velg Eksporter (API) for å lagre arbeidsflyten som en

*.json-fil.Kopier den JSON-filen til

~/.openshot_qt/comfyui/.Start OpenShot på nytt, eller åpne prosjektet på nytt om nødvendig.

OpenShot laster automatisk arbeidsflyten og viser den i riktig AI-meny. Når du aktiverer den fra OpenShot, sendes den valgte kildefilen inn i arbeidsflyten, og utdata fra arbeidsflytens siste utgangsnode importeres tilbake til Prosjektfiler.

OpenShot skriver også en .openshot_qt/comfyui/debug.json-fil for avanserte brukere som ønsker å inspisere den nøyaktige forespørselen sendt til ComfyUI.

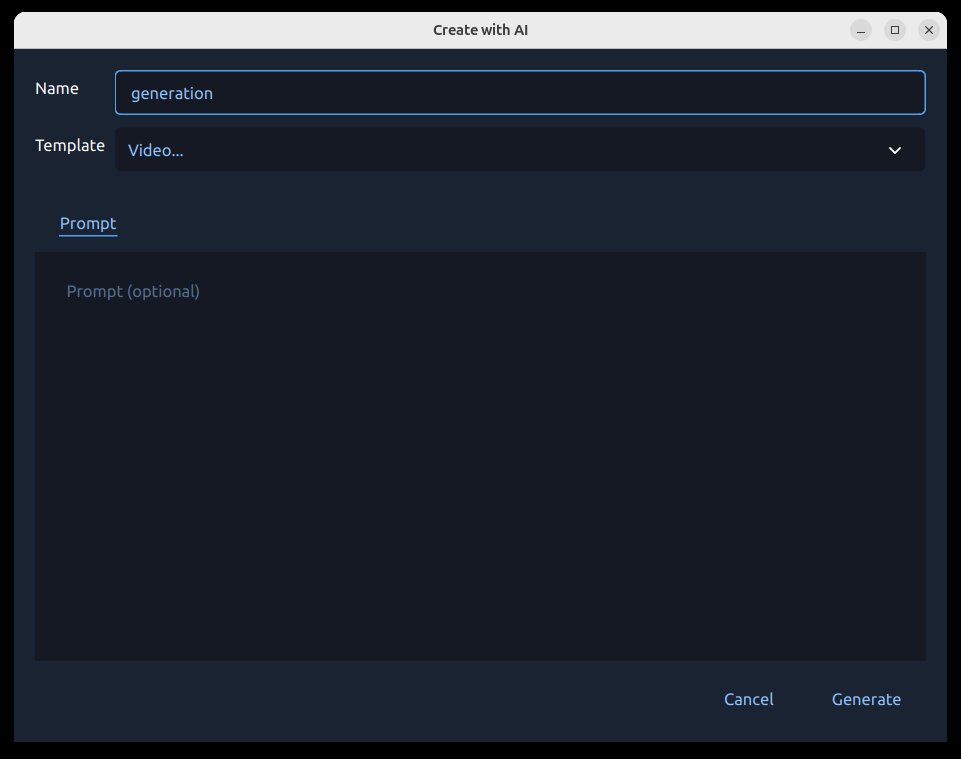

AI-handlingsdialog

Både Opprett med AI og Forbedre med AI åpner den samme genereringsdialogen.

Hvorfor denne dialogen er viktig:

Den samler alle AI-inndata på ett sted.

Den validerer nødvendige felt før jobben settes i kø.

Den lar deg sette opp sporingsinstrukser før kostbare kjøringer.

Hva du kan gjøre i dialogen:

Velg arbeidsflyt/handling.

Skriv inn prompt-teksten.

Forhåndsvis den valgte kildefilen (for forbedringsarbeidsflyter).

Angi utdata-navnet for generert media.

Velg et referansebilde i Reference-fanen for arbeidsflyter som krever det.

Oppgi sporingspunkter/rektangler for sporingsarbeidsflyter.

Start jobben med Generer eller lukk med Avbryt.

Sporing (Maske, Uskarphet, Fremhev)

Sporingsarbeidsflyter (Uskarphet…, Fremhev…, Maske…) bruker et område der du markerer hva som skal inkluderes og hva som skal ignoreres.

Hvorfor dette er viktig

Sporing hjelper effekten din å følge et bevegelig motiv over tid. For eksempel kan du uskarpe et ansikt, fremheve en spiller, eller generere en ren maske som følger det samme objektet over mange bilder.

Sporingsikoner

Ikon / Markør |

Betydning |

|---|---|

Blå prikk |

Positiv sporingskoordinat (forgrunn/motiv startpunkt). |

Rød prikk |

Negativ sporingskoordinat (bakgrunn/utelukkingsstartpunkt). |

Blå rektangel |

Positiv regionsstart (bred motivindikasjon). |

Rød rektangel |

Negativ regionsstart (bred utelukkelsesindikasjon). |

Slett ikon |

Fjern alle nåværende sporingsstartpunkter (punkter/rektangler) og start på nytt. |

Hvordan sporing fungerer

OpenShot sender dine positive og negative markører som startkoordinater til sporingsmodellen, som bygger en maske for motivet og følger det over tid. Bedre startpunkter gir vanligvis renere masker og mindre forskyvning. [sam2]

Hvordan bruke det

Velg et bilde der motivet er tydelig synlig.

Start med en blå prikk på motivet.

Legg til røde prikker på nærliggende bakgrunn bare om nødvendig.

Legg til rektangler når du trenger raskere bredt utvalg.

Gjenta på flere bilder når bevegelse/form endres.

Justering over tid (bildeskyver):

Flytt bildeskyveren til forskjellige øyeblikk i klippet.

Legg til eller juster prikker/rektangler på bilder der sporing begynner å gli.

Bruk ekstra startpunkter bare der det trengs, spesielt ved tildekking, rask bevegelse eller store formendringer.

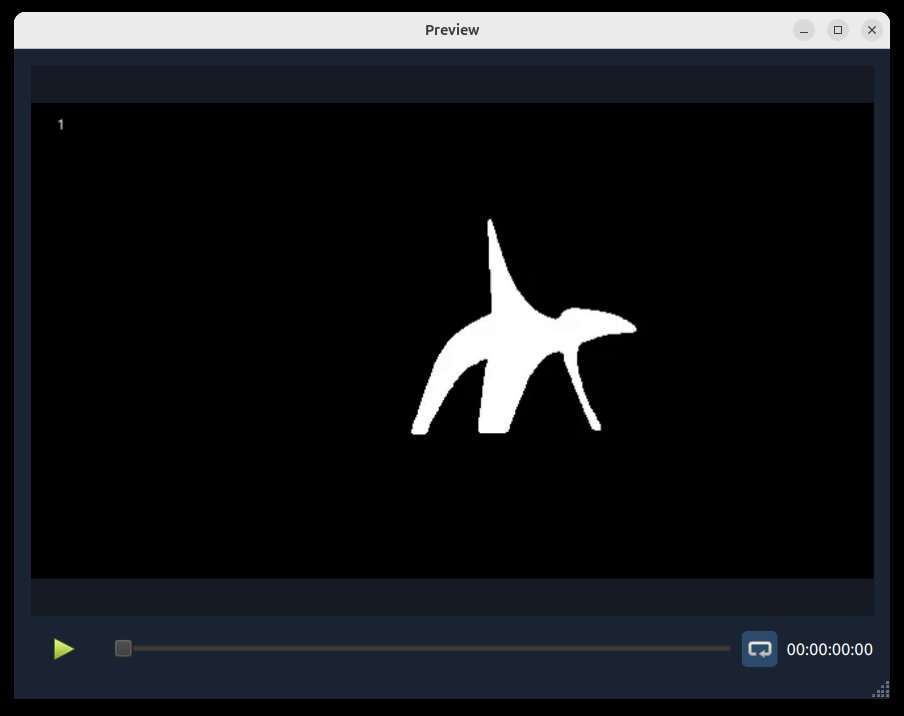

Forhåndsvisning av maskeutdata (fra denne sporingsprosessen):

Beste praksis

Bruk først et kort testklipp.

Start enkelt: en enkelt blå prikk er ofte nok.

Legg til flere punkter bare der sporing feiler.

Legg til et mer nyansert sett med positive/negative punkter og rektangler om nødvendig.

Hold positive og negative punkter tydelig adskilt.

Hvis sporing blir rotete, bruk Slett-ikonet og start på nytt med renere startpunkter.

SAM2 (Segment Anything Model 2) prosjekt: facebookresearch/sam2

Jobbkø, fremdrift og avbryt

Etter at du klikker Generer, settes forespørselen i kø og kjøres i OpenShots AI-jobbkø.

Fremdrift vises i Prosjektfiler (merker og statusmelding).

Fullførte resultater importeres tilbake til Prosjektfiler.

Aktive jobber kan kanselleres ved å høyreklikke på den genererte prosjektfilen med fremdriftslinjen og velge Avbryt jobb.

Resultater lagres under

.openshot_qt/comfyui-output/.

Innebygde JSON-arbeidsflyter

Seksjonene nedenfor kartlegges direkte til innebygde JSON-maler i comfyui/. Hvert underavsnitt beskriver hvorfor du kan bruke det, hvordan du kjører det og nøkkeldetaljer.

Lag med AI

Bilde… (txt2img-basic)

Hvorfor: Generer stillbilder fra en tekstprompt.

Hvordan: Velg Lag med AI -> Bilde…, skriv inn en prompt, og generer deretter.

Detaljer: Bruker

comfyui/txt2img-basic.jsonmedsd_xl_base_1.0.safetensors.

Video… (txt2video-svd)

Hvorfor: Generer korte videoklipp fra tekst.

Hvordan: Velg Lag med AI -> Video…, skriv inn en prompt, og generer deretter.

Detaljer: Bruker

comfyui/txt2video-svd.jsonmed WAN-videogenereringsmodeller.

Lyd… (txt2audio-stable-open)

Hvorfor: Generer ikke-musikalsk lyd fra tekstprompter.

Hvordan: Velg Lag med AI -> Lyd…, skriv inn en prompt, og generer deretter.

Detaljer: Bruker

comfyui/txt2audio-stable-open.jsonmed Stable Audio Open-modeller.

Musikk… (txt2music-ace-step)

Hvorfor: Generer musikk fra stil/tagger (og valgfrie tekster).

Hvordan: Velg Lag med AI -> Musikk…, skriv inn prompttekst, og generer deretter.

Detaljer: Bruker

comfyui/txt2music-ace-step.jsonmed et Ace-Step 1.5-sjekkpunkt.

Forbedre med AI

Endre bildestil… (img2img-basic)

Hvorfor: Endre stil på et eksisterende bilde samtidig som komposisjonen beholdes.

Hvordan: Velg Forbedre med AI på et bilde, skriv inn en stilprompt, og generer deretter.

Detaljer: Bruker

comfyui/img2img-basic.jsonmedsd_xl_base_1.0.safetensors.

Dybde (image-extract-depth)

Hvorfor: Eksporter et gråtone dybdekart fra et kildebilde.

Hvordan: Velg Enhance with AI -> Extract -> Depth på et bilde, og generer deretter.

Detaljer: Bruker

comfyui/image-extract-depth.jsonmedDepthAnythingV2Preprocessor.

Linjer (image-extract-lines)

Hvorfor: Eksporter et linjekart fra et kildebilde.

Hvordan: Velg Enhance with AI -> Extract -> Lines på et bilde, og generer deretter.

Detaljer: Bruker

comfyui/image-extract-lines.jsonmedLineArtPreprocessor.

Bilde til video… (img2video-wan)

Hvorfor: Gjør et stillbilde om til et generert videoklipp.

Hvordan: Velg Forbedre med AI på et bilde, gi promptveiledning, og generer deretter.

Detaljer: Bruker

comfyui/img2video-wan.jsonmed WAN 2.2 bilde-til-video-modeller.

Endre videostil… (video2video-basic)

Hvorfor: Bruk en ny visuell stil på en kildevideo.

Hvordan: Velg Enhance with AI på en video, skriv inn en stilprompt, velg et referansebilde i Reference-fanen, og generer deretter.

Detaljer: Bruker

comfyui/video2video-basic.jsonmed WAN VACE video-til-video-noder, et påkrevd referansebilde, blandetDepthAnythingV2Preprocessordybde pluss Canny-kantkontroll, og modellenewan2.1_vace_1.3B_fp16.safetensors,wan_2.1_vae.safetensorsogumt5_xxl_fp8_e4m3fn_scaled.safetensors.

Dybde (video-extract-depth)

Hvorfor: Eksporter en gråtone dybdekartversjon av en kildevideo.

Hvordan: Velg Enhance with AI -> Extract -> Depth på en video, og generer deretter.

Detaljer: Bruker

comfyui/video-extract-depth.jsonmedDepthAnythingV2Preprocessorog bevarer kilderammens bildefrekvens.

Linjer (video-extract-lines)

Hvorfor: Eksporter en linjekartversjon av en kildevideo.

Hvordan: Velg Enhance with AI -> Extract -> Lines på en video, og generer deretter.

Detaljer: Bruker

comfyui/video-extract-lines.jsonmedLineArtPreprocessorog bevarer kilderammens bildefrekvens.

Øk oppløsning (bilde) (upscale-realesrgan-x4)

Hvorfor: Forstørr bilder med lav oppløsning.

Hvordan: Velg Forbedre med AI på et bilde, velg øk oppløsning, og generer deretter.

Detaljer: Bruker

comfyui/upscale-realesrgan-x4.jsonmedRealESRGAN_x4plus.safetensors.

Øk oppløsning (video) (video-upscale-gan)

Hvorfor: Forstørr videorammer for høyere synlig detalj.

Hvordan: Velg Forbedre med AI på en video, velg øk oppløsning, og generer deretter.

Detaljer: Bruker

comfyui/video-upscale-gan.jsonmedRealESRGAN_x4plus.safetensors.

Jeven bevegelse (2x bildefrekvens) (video-frame-interpolation-rife2x)

Hvorfor: Øk bildefrekvens for jevnere oppfattet bevegelse.

Hvordan: Velg Forbedre med AI på en video, velg jevn bevegelse, og generer deretter.

Detaljer: Bruker

comfyui/video-frame-interpolation-rife2x.jsonmedrife47.pth.

Del opp i scener (video-segment-scenes-transnet)

Hvorfor: Oppdag sceneskift automatisk og del lange klipp i segmenter.

Hvordan: Velg Forbedre med AI på en video, velg scenedeling, og generer deretter.

Detaljer: Bruker

comfyui/video-segment-scenes-transnet.jsonmed TransNetV2.

Legg til undertekster fra tale (video-whisper-srt)

Hvorfor: Transkriber tale til undertekst-/tekstfil.

Hvordan: Velg Forbedre med AI på en video, velg undertekster, og generer deretter.

Detaljer: Bruker

comfyui/video-whisper-srt.jsonog lager SRT-utdata.

Sporingsarbeidsflyter (SAM2)

Disse arbeidsflytene bruker samme region-/sporingsinngangsprosess og er gruppert i sporingskontekstmenyen.

Slør… (bilde) (image-blur-anything-sam2)

Hvorfor: Slør valgte motivområder i et stillbilde.

Hvordan: Velg punkter/rektangler for motivet, og generer deretter.

Detaljer: Bruker

comfyui/image-blur-anything-sam2.jsonmed SAM2 bildesegmentering.

Fremhev… (bilde) (image-highlight-anything-sam2)

Hvorfor: Fremhev valgte motivområder i et stillbilde.

Hvordan: Velg punkter/rektangler for motivet, og generer deretter.

Detaljer: Bruker

comfyui/image-highlight-anything-sam2.jsonmed SAM2 bildesegmentering.

Maske… (bilde) (image-mask-anything-sam2)

Hvorfor: Lag en bildemaske for valgte motivområder.

Hvordan: Velg punkter/rektangler for motivet, og generer deretter.

Detaljer: Bruker

comfyui/image-mask-anything-sam2.jsonmed SAM2 bildesegmentering.

Slør… (video) (video-blur-anything-sam2)

Hvorfor: Spor og slør et bevegelig motiv i video.

Hvordan: Merk motiv/bakgrunn i regionsskjermen, og generer deretter.

Detaljer: Bruker

comfyui/video-blur-anything-sam2.jsonmed SAM2-videosporing.

Fremhev… (video) (video-highlight-anything-sam2)

Hvorfor: Spor og fremhev et bevegelig motiv i video.

Hvordan: Merk motiv/bakgrunn i regionsskjermen, og generer deretter.

Detaljer: Bruker

comfyui/video-highlight-anything-sam2.jsonmed SAM2-videosporing.

Maske… (video) (video-mask-anything-sam2)

Hvorfor: Lag en animert maske som følger et bevegelig motiv.

Hvordan: Merk motiv/bakgrunn i regionsskjermen, og generer deretter.

Detaljer: Bruker

comfyui/video-mask-anything-sam2.jsonmed SAM2-videosporing.

Startpunkter for nye brukere

Hvis du er ny med disse verktøyene, start med:

Lag med AI -> Bilde

Forbedre med AI -> Øk oppløsning

Forbedre med AI -> Glatt bevegelse

Forbedre med AI -> Del opp i scener

Forbedre med AI -> Legg til undertekster

Feilsøking

Hvis AI-menyene ikke vises eller oppgaver feiler umiddelbart:

Bekreft at ComfyUI kjører og er tilgjengelig på den konfigurerte URL-en.

Bekreft at nødvendige modeller finnes i ditt ComfyUI-miljø.

Bekreft at tilpassede node-pakker er installert for arbeidsflyten du valgte.

Reduser batch-/delskiver for lange klipp.

Test på nytt med et kort klipp eller stillbilde først.

For generell ytelse og cache-justering, se Innstillinger og Avspilling.